Linux CPU |

Linux GPU |

Mac OS CPU |

Windows CPU |

|---|---|---|---|

|

|

|

|

基于多任务卷积网络(MTCNN)和Center-Loss的多人实时人脸检测和人脸识别系统。

DFace 是个开源的深度学习人脸检测和人脸识别系统。所有功能都采用 pytorch 框架开发。pytorch是一个由facebook开发的深度学习框架,它包含了一些比较有趣的高级特性,例如自动求导,动态构图等。DFace天然的继承了这些优点,使得它的训练过程可以更加简单方便,并且实现的代码可以更加清晰易懂。 DFace可以利用CUDA来支持GPU加速模式。我们建议尝试linux GPU这种模式,它几乎可以实现实时的效果。 所有的灵感都来源于学术界最近的一些研究成果,例如 Joint Face Detection and Alignment using Multi-task Cascaded Convolutional Networks 和 FaceNet: A Unified Embedding for Face Recognition and Clustering

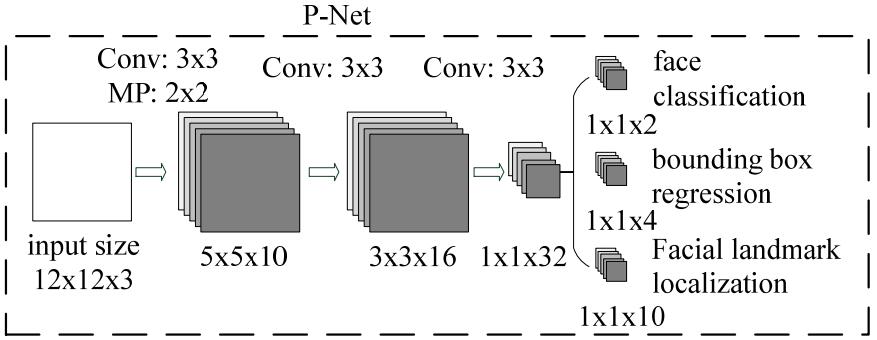

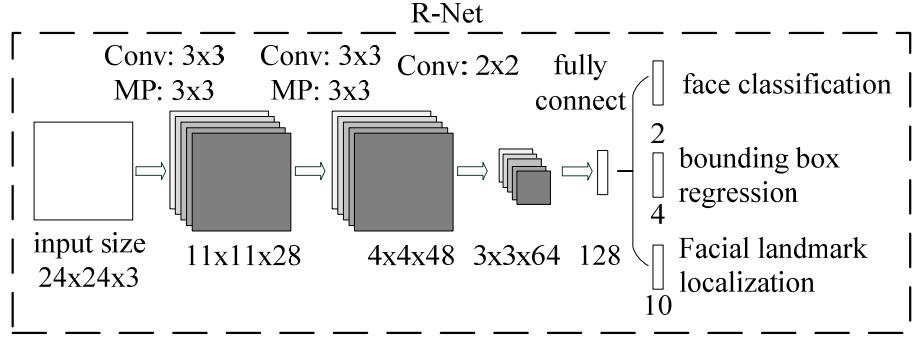

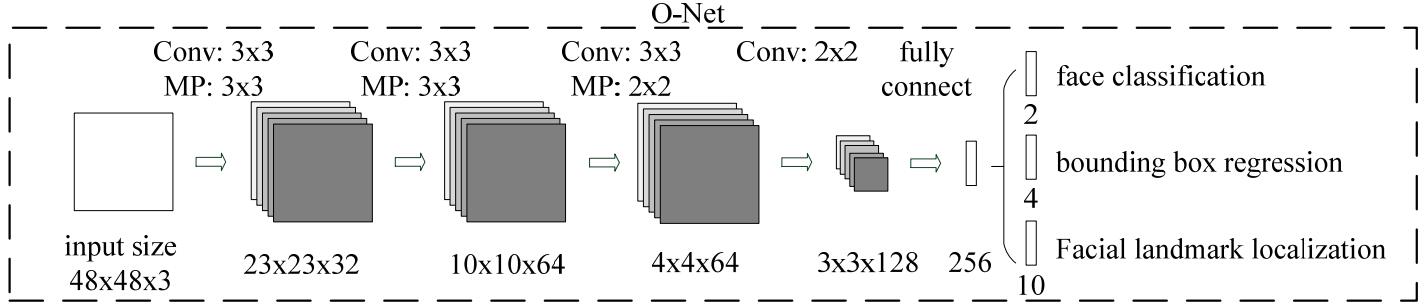

MTCNN 结构

如果你对DFace感兴趣并且想参与到这个项目中, 以下TODO是一些需要实现的功能,我定期会更新,它会实时展示一些需要开发的清单。提交你的fork request,我会用issues来跟踪和反馈所有的问题。也可以加DFace的官方Q群 681403076 也可以加本人微信 jinkuaikuai005

DFace主要有两大模块,人脸检测和人脸识别。我会提供所有模型训练和运行的详细步骤。你首先需要构建一个pytorch和cv2的python环境,我推荐使用Anaconda来设置一个独立的虚拟环境。如果使用GPU训练模式,需要安装Nvidia的cuda和cudnn。 目前作者倾向于Linux Ubuntu安装环境。感谢热心网友提供windows DFace安装体验,windos安装教程具体 可参考他的博客

git clone https://gitee.com/kuaikuaikim/dface.git

在这里我提供了一个anaconda的环境依赖文件environment.yml (windows请用environment-win64.yml,Mac OSX请用environment_osx.yaml),它能方便你构建自己的虚拟环境。

cd dface

conda env create -f environment.yml

添加python搜索模块路径

export PYTHONPATH=$PYTHONPATH:{your local DFace root path}

如果你对mtcnn模型感兴趣,以下过程可能会帮助到你。

MTCNN主要有三个网络,叫做PNet, RNet 和 ONet。因此我们的训练过程也需要分三步先后进行。为了更好的实现效果,当前被训练的网络都将依赖于上一个训练好的网络来生成数据。所有的人脸数据集都来自 WIDER FACE 和 CelebA。WIDER FACE仅提供了大量的人脸边框定位数据,而CelebA包含了人脸关键点定位数据。以下训练除了 生成ONet的人脸关键点训练数据和标注文件 该步骤使用CelebA数据集,其他一律使用WIDER FACE。如果使用wider face的 wider_face_train.mat 注解文件需要转换成txt格式的,我这里用h5py写了个 转换脚本. 这里我提供一个已经转换好的wider face注解文件 anno_store/wider_origin_anno.txt, 以下训练过程参数名--anno_file默认就是使用该转换好的注解文件。

mkdir {your dface traindata folder}

python dface/prepare_data/gen_Pnet_train_data.py --prefix_path {注解文件中图片的目录前缀,就是wider face图片所在目录} --dface_traindata_store {之前创建的dface训练数据临时目录} --anno_file {wider face 注解文件,可以不填,默认使用anno_store/wider_origin_anno.txt}

python dface/prepare_data/assemble_pnet_imglist.py

python dface/train_net/train_p_net.py

python dface/prepare_data/gen_Rnet_train_data.py --prefix_path {注解文件中图片的目录前缀,就是wider face图片所在目录} --dface_traindata_store {之前创建的dface训练数据临时目录} --anno_file {wider face 注解文件,可以不填,默认使用anno_store/wider_origin_anno.txt} --pmodel_file {之前训练的Pnet模型文件}

python dface/prepare_data/assemble_rnet_imglist.py

python dface/train_net/train_r_net.py

python dface/prepare_data/gen_Onet_train_data.py --prefix_path {注解文件中图片的目录前缀,就是wider face图片所在目录} --dface_traindata_store {之前创建的dface训练数据临时目录} --anno_file {wider face 注解文件,可以不填,默认使用anno_store/wider_origin_anno.txt} --pmodel_file {之前训练的Pnet模型文件} --rmodel_file {之前训练的Rnet模型文件}

python dface/prepare_data/gen_landmark_48.py

python dface/prepare_data/assemble_onet_imglist.py

python dface/train_net/train_o_net.py

如果不想训练,我已经把onet_epoch.pt,pnet_epoch.pt,rnet_epoch.pt三个文件放到model_store目录,直接运行test_image.py即可

python test_image.py

TODO 根据center loss实现人脸识别

此处可能存在不合适展示的内容,页面不予展示。您可通过相关编辑功能自查并修改。

如您确认内容无涉及 不当用语 / 纯广告导流 / 暴力 / 低俗色情 / 侵权 / 盗版 / 虚假 / 无价值内容或违法国家有关法律法规的内容,可点击提交进行申诉,我们将尽快为您处理。